Das Stichwort KI löst eine Mischung aus Faszination und Schrecken aus. Wir staunen über die Effekte, aber wir können nicht richtig einschätzen, was diese KI eigentlich ist. Was es für die Zukunft unserer Arbeitswelt bedeutet. Und wie sich unser Alltag und unser Zusammenleben als Gesellschaft verändern werden.

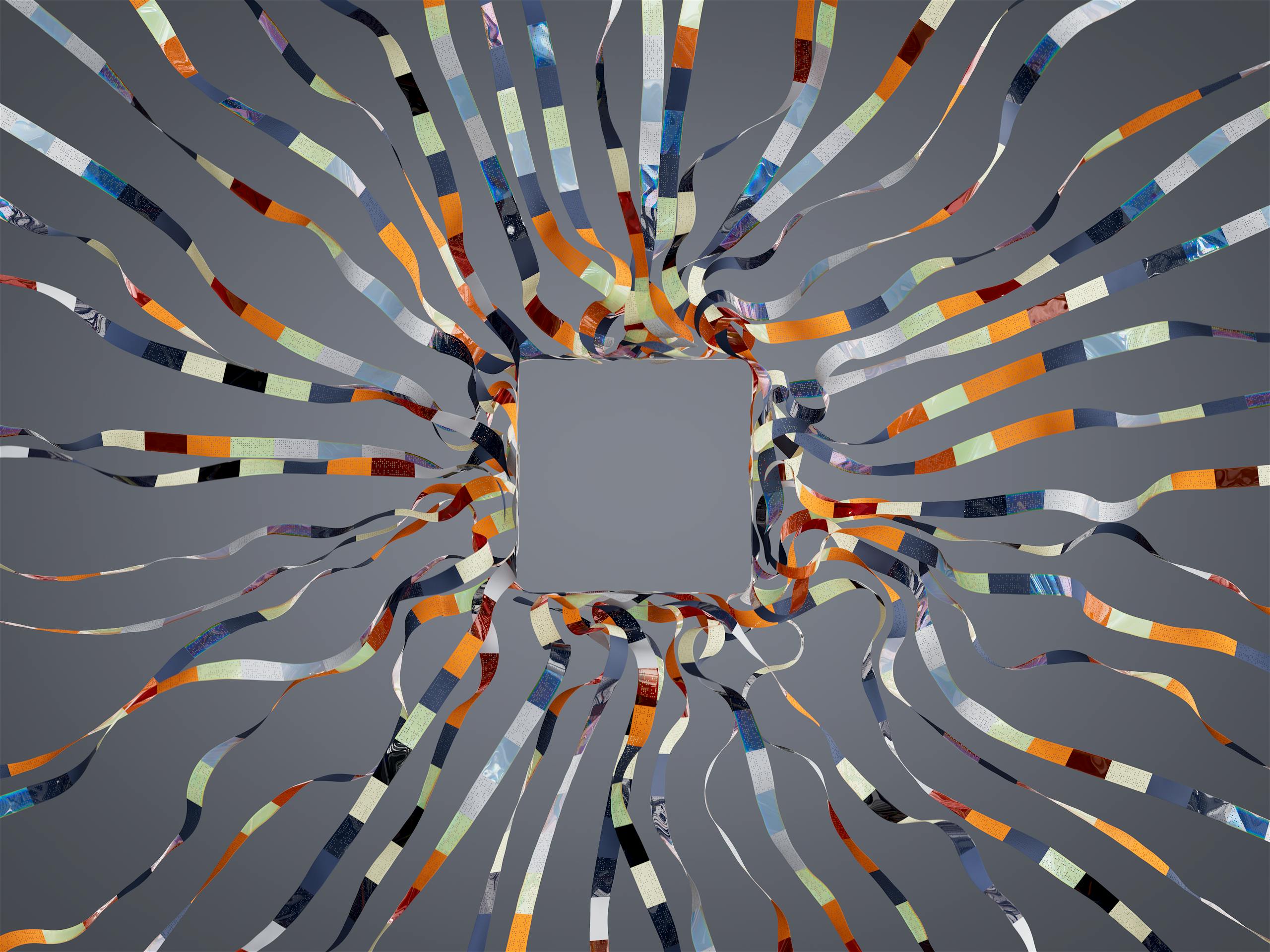

Es ist schon eindrucksvoll, wenn ein KI-Tool aus einer knappen Textanweisung einen kompletten Blog-Artikel produziert. Oder ein Foto, das vollkommen realistisch aussieht. Das System hat das Bild nicht erfunden. Alle Teile dieses Bildes hat irgendwann irgendjemand erschaffen. In Form von einem Foto oder einer Illustration. Midjourney, DALL-E & Co. setzen nur neu zusammen. Die Systeme kreieren so gesehen nichts Neues, sie kombinieren lediglich Vorhandenes neu.

In diesem Artikel geht es um das Konzept Künstliche Intelligenz. Etwas konkreter wird es in diesem Artikel Brauche ich KI für meine Website?

Das überforderte Steinzeit-Hirn

Ich habe nur eine sehr ungenaue Vorstellung von KI. Es fällt mir schwer, die abstrakten mathematischen und statistischen Konzepte hinter neuronalen Netzen zu erfassen. KI ist kein Thema, das sich intuitiv einschätzen lässt. Unser Gehirn ist dafür nicht gemacht. KI funktioniert technisch sehr gut, aber kaum jemand versteht, warum.

Gleichzeitig ist die Faszination groß. Da ist ein Ding, das man etwas fragen kann, mit dem man ein Gespräch führen kann. Das auf alles eine Antwort hat und alles zu wissen scheint.

Wer hat’s erfunden?

Eine ungeklärte und meiner Meinung nach sehr brisante Frage ist das Urheberrecht. Die Trainingsdaten kommen ja irgendwo her, irgendjemand hat das alles mal geschrieben, gesagt, gecodet, fotografiert oder gezeichnet. Im Moment ist nicht geregelt, welche Daten eine Firma für ihre Produkte abgreifen darf. Auch das Thema Privatsphäre ist ungeklärt. Die Big Player lesen bei jedem Social-Media-Post und bei jeder Nachricht mit.

Suchmaschinen listen die Quellen auf, die zu einem Suchwort passen. Bei KI gibt es keine Quellen mehr. Es gibt nur noch Trainingsdaten, die sind aber nicht zugänglich.

Halluzinationen und Fakes

Damit die Modelle damit rechnen können, werden die Trainingsdaten in unzählige kleine Stückchen (Tokens) zerteilt. Aus diesem Daten-Schrot und jeder Menge Statistik bauen die Systeme ihre Inhalte zusammen. Das Modell rechnet einfach so lange, bis etwas Passendes rauskommt. Das Haupt-Kriterium dabei ist Wahrscheinlichkeit.

So kann es passieren, dass z.B. Texte entstehen, die zwar glaubwürdig klingen, die aber keinen Realitätsbezug haben. Das KI-Tool zitiert beispielsweise Quellen, die nicht existieren. Diese Fehler sind bekannt, sie sind eine logische Folge der Wahrscheinlichkeits-Methodik. Die Systeme könnten diese Fehler korrigieren, aber das würde wertvolle Zeit kosten. Momentan werden die Fehler in Kauf genommen, schnelle Ergebnisse sind den Anbietern wichtiger als korrekte Ergebnisse.

Man kann mit KI auch prima Informationen manipulieren und fälschen. Die Algorithmen der Social-Media-Plattformen sind der perfekte Nährboden dafür. Im Lifestyle- und Beauty-Bereich wurden schon immer stark idealisierte Bilder und Videos produziert. Die Produktion solcher Inhalte wird durch KI um ein Vielfaches leichter. Authentische Bilder verschwinden. Ganze Plattformen wie Pinterest werden inzwischen von AI generierten Fotos überschwemmt.

Die Tatsache, dass unser Hirn auf negative Nachrichten besonders zuverlässig reagiert, spielt eine problematische Rolle. Im besten Fall sind die mit KI generierten Videos lustig, aber oft sind sie provokativ und häufig auf der böswilligen Seite (Stichwort Deep Fakes). Ein „Aufreger“ sticht eine positive Botschaft im Kampf um Aufmerksamkeit jederzeit aus. Mit Posts, die negative Emotionen erzeugen, kriegt man die meisten Likes.

Die Unterscheidung – was ist real, was ist Fälschung – wird immer schwerer. Viele Menschen halten KI generierte Inhalte für authentisch. Das ist ein massives gesellschaftliches und politisches Problem.

Fazit

KI ist zwar nur ein Tool, aber eines mit sehr viel Potenzial. Potenzial, das schwer einzuschätzen ist. Und das in einem gesellschaftlichen und politischen Kontext wirkt.

Es gibt viele nützliche Anwendungen, wie zum Beispiel in der Medizintechnik. Aber der Einfluss der Technologie auf unsere Gesellschaft ist so massiv, dass wir dafür politische Regeln finden müssen. Es sind alle Lebensbereiche betroffen. Kritische Themen wie politische Meinungsbildung, psychische Gesundheit oder Waffentechnik können wir nicht großen Konzernen überlassen, die allein ihren Profit im Auge haben.

Zum Nachlesen und Nachgucken

- Diese Artikelserie von Herrn Rau behandelt das Thema LLM sehr detail- und kenntnisreich. Auch wenn ich nur wenig verstanden habe, habe ich eine Menge mitgenommen. Es gibt insgesamt sieben Teile. Hier ist der erste: LLM Grundlagen, Teil 1

- Was sind Large Language Models? Und was ist bei der Nutzung von KI-Sprachmodellen zu beachten?

Ein Artikel vom Fraunhofer-Institut für Experimentelles Software-Engineering - Ein Video, das sich auf unterhaltsame, aber sehr informative Art mit dem Thema „AI Slop“ beschäftigt: AI Slop | John Oliver Last Week Tonight

- Faktencheck: Warum wir Fake News glauben. Ein Artikel der Deutschen Welle (DW)

- Wer auf Fehlinformationen hereinfällt und warum Eine systematische Metaanalyse zu Online-Fehlinformationen

- Künstliche Intelligenz und Urheberrecht Artikel von Dr. Andreas Dustmann, Rechtsanwalt